מתי מודל AI כללי לא מספיק?

GPT-4 ו-Claude מרשימים — אבל הם נאמנו על ידע כללי. הם לא מכירים את הטרמינולוגיה הרפואית בעברית של המרפאה שלך, לא מבינים את קטגוריות התביעות הייחודיות של חברת הביטוח שלך, ולא יודעים לזהות את הפגם הספציפי בפס הייצור שלך. כשהדיוק חשוב — והוא תמיד חשוב בסביבה עסקית — מודל מותאם הוא ההבדל בין 70% ל-95% Accuracy.

מתי בונים מודל מותאם: ספק רפואי שצריך NLP שמבין מינוח רפואי בעברית ומבדיל בין אבחנות דומות. חברת ביטוח שמסווגת 500 תביעות בחודש לפי 30 קטגוריות ספציפיות. מפעל שצריך Computer Vision לזיהוי פגמים בייצור עם 99.5% דיוק. חברת נדל"ן שמעריכה שווי נכסים מנתוני שוק ישראלי ב-Real-time. בכל המקרים האלה — מודל כללי לא מספיק, ומודל מותאם מחזיר את ההשקעה.

Fine-tuning: ממודל כללי למודל שמדבר את השפה שלך

Fine-tuning לוקח מודל קיים (GPT-4, Llama 3, Mistral) ומאמן אותו מחדש על הדאטה שלך. "מלמד" אותו את הסגנון, הטרמינולוגיה, הפורמטים ועקרונות הדומיין. מודל Fine-tuned לתחום משפטי יכתוב סעיף חוזה שנשמע כמו עורך דין — לא כמו ChatGPT. מודל Fine-tuned לשירות לקוחות של חברת טלקום ידע לענות "המגבלה שלך מתחדשת ב-1 לחודש" — לא תשובה גנרית על "בדוק את החשבון שלך."

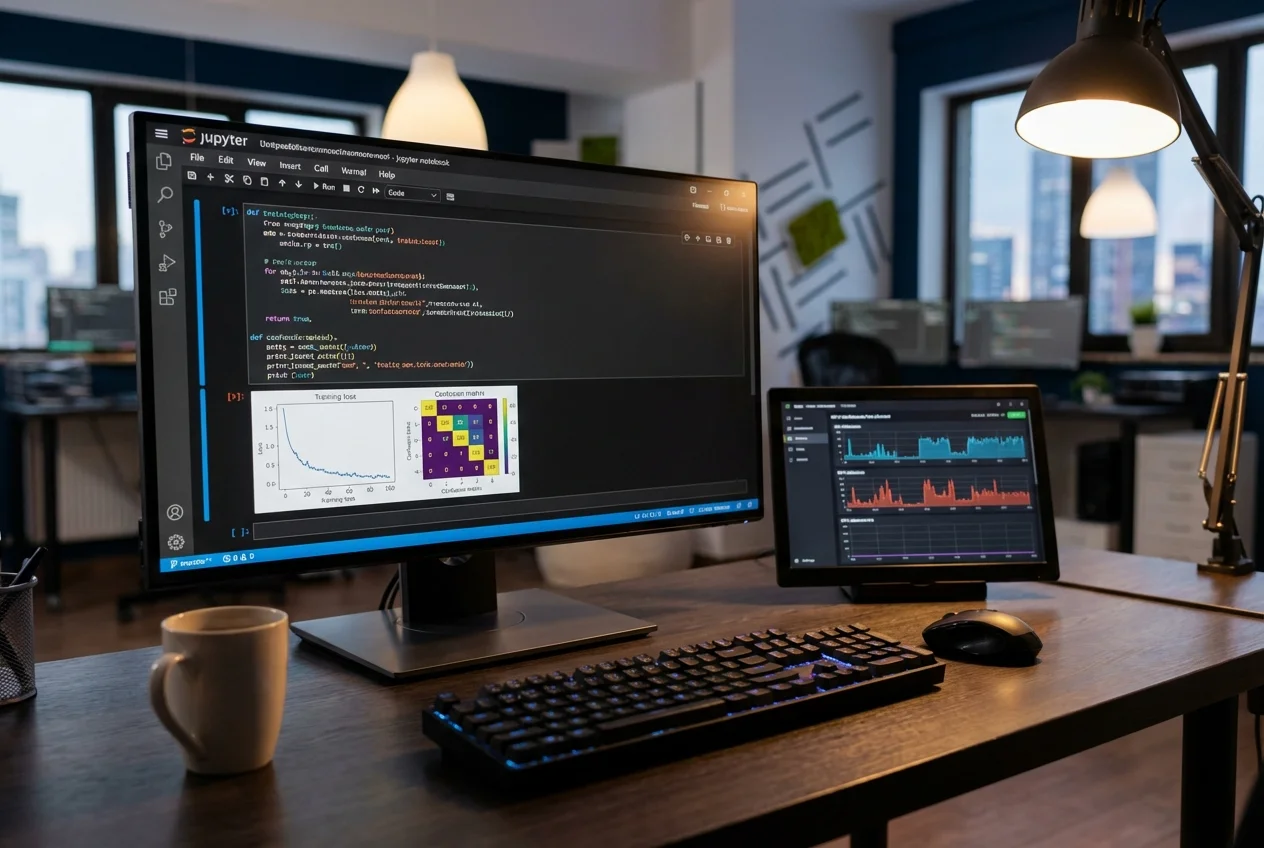

התהליך: Dataset מותאם (1,000-10,000 דוגמאות של Input-Output שמייצגות את ה-Use Case). Data Preparation — ניקוי, עיצוב, Quality Check. Training על GPU Infrastructure (A100/H100). Evaluation קפדני על Test Set שהמודל לא ראה. Iteration — אם הדיוק לא מספיק, משפרים את הדאטה ומאמנים שוב. אנחנו מנהלים את כל התהליך — ממיפוי הצרכים ועד מודל בייצור.

Training על דאטה קנייני: הנתונים נשארים בבית

לתעשיות עם נתונים רגישים — בנקאות, ביטוח, בריאות, ביטחון — שליחת נתונים ל-Cloud של OpenAI אינה אפשרות. אנחנו בונים Training Pipeline שנשאר לגמרי תחת שליטתך. On-Premise: GPU Server בארגון שלך, המודל מאומן ופועל מאחורי ה-Firewall. Private Cloud: AWS/GCP/Azure עם Full Data Isolation — הנתונים לא יוצאים מה-Region שבחרת. Federated Learning: שיתוף ידע בין מחלקות/סניפים בלי לשתף את הנתונים עצמם.

Pipeline שלנו עומד בדרישות GDPR, חוק הגנת הפרטיות הישראלי, ISO 27001, SOC2, ו-HIPAA (לתחום הרפואי). לא Shortcuts — Compliance מלא מהיום הראשון. זה אומר Encryption at Rest ו-In Transit, Access Control מבוסס-תפקיד, Audit Logs של כל גישה לנתונים, ו-Data Retention Policies ברורות.

Model Evaluation: מספרים, לא "נראה טוב"

אף מודל לא עולה ל-Production בלי Evaluation קפדני. אנחנו מגדירים Metrics מראש: Accuracy, F1-Score, Precision/Recall לסיווג. BLEU/ROUGE ליצירת טקסט. AUC-ROC לחיזויים. Holdout Test Set — נתונים שהמודל מעולם לא ראה — לבדיקת ביצועים אמיתיים. Bias Testing — וידוא שהמודל מתפקד באותה רמה לכל קבוצות המשתמשים. Human Evaluation — מומחי תחום בודקים מדגם תוצאות ומדרגים.

Acceptance Criteria ברורים: "המודל ייכנס לייצור כאשר יגיע ל-90% Precision ב-Test Set עם 0% False Positive Rate על סיווגים קריטיים." אם לא מגיעים — לא עולים ל-Production. ממשיכים לשפר את הדאטה, את ה-Architecture, או מוותרים ומחפשים גישה אחרת. כנות קודמת ל-Deploy.

MLOps: מודל בייצור זה רק ההתחלה

בניית מודל = 50% מהעבודה. ניהולו בייצור = ה-50% האחרים. MLOps שלנו כולל: Model Versioning — כל גרסת מודל נשמרת, Rollback מהיר אם גרסה חדשה מדרדרת. Model Monitoring — Dashboard שעוקב אחרי Accuracy בזמן אמת על נתוני Production. Drift Detection — התראה אוטומטית כשביצועי המודל יורדים (Model Drift). A/B Testing — הרצה מקבילה של 2 גרסאות מודל לבדיקת מי עובד טוב יותר. Automated Retraining — כשנצבר מספיק דאטה חדש, המודל מתאמן מחדש אוטומטית.

Model Drift הוא אויב שקט: מודל שעובד מצוין בינואר עלול להתדרדר עד יולי — כי השוק השתנה, הלקוחות השתנו, או הטרמינולוגיה התעדכנה. בלי ניטור — אף אחד לא מבחין. עם MLOps — מזהים ירידה בדיוק תוך ימים ומתקנים לפני שהנזק מצטבר. מודל שמנוטר = מודל שמשתפר לאורך זמן. מודל שלא מנוטר = Risk עסקי.

אוטומציה מבוססת AI

אוטומציה מבוססת AI סוכני AI

סוכני AI עיבוד שפה טבעית

עיבוד שפה טבעית ניתוח נתונים ו-AI

ניתוח נתונים ו-AI אינטגרציות AI

אינטגרציות AI